こんにちは.高山です.

参加から大分時間が経ってしまったのですが,KaggleのStable Diffusion-Image to Promptsというコンテストに参加していました.

ふと流行りのStable Diffusionについて勉強してみたくなってコンテスト終了2週間前に参加を決めました.

流石にこの期間だと私の実力ではベースラインを少しいじる程度が限界でしたが,タイトな分集中できて有意義な時間が過ごせたと思います.

更新履歴 (大きな変更のみ記載しています)

- 2024/09/17: タイトル,タグ,節構成を更新しました

コンテストの紹介

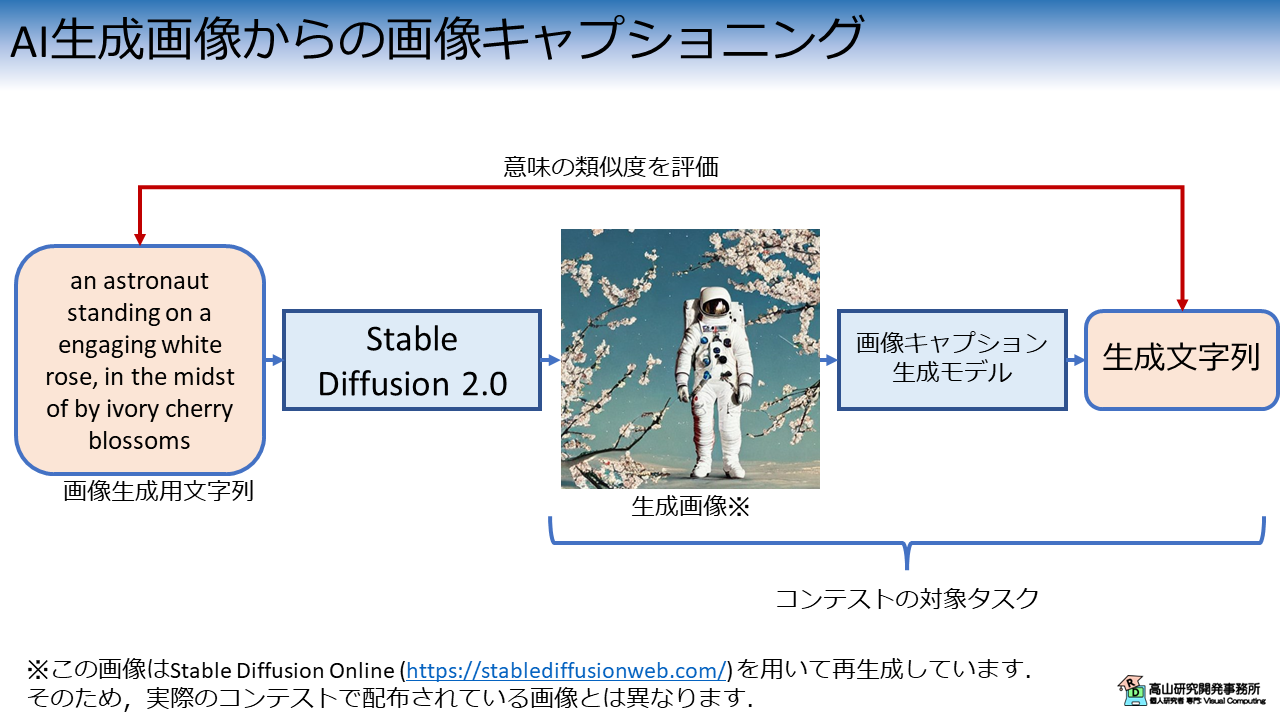

このコンテストは,図1に示すように画像を入力してその説明文を生成する,画像キャプショニングと呼ばれるタスクなのですが問題設定が少し変わっています.

入力画像はStable Diffusion 2.0 [Stability-AI'23, Rombach'23]という文字列から画像を自動生成する技術で作られた画像になります.

参加者は各自の画像キャプショニングモデルを用いて生成画像からキャプションを生成します.

入力画像を生成するのに使われたキャプション (以降,参照キャプション) と,入力画像から生成したキャプション (以降,生成キャプション) の意味の類似度を評価して競い合います.

なお,意味の類似度は下記のような手順で評価します.

- 参照キャプションと生成キャプションを,それぞれ大規模データで学習した言語モデル [SBERT'23, Reimers'19]に入力し特徴量に変換します.

- 特徴量間のコサイン類似度を算出します.

このタスクは一般的な写真画像で学習された画像キャプショニングモデルでは性能に限界があるため,生成画像用のデータセットを用いてモデルを学習する必要があります.

コンテスト期間中は簡単なファインチューニング程度しかできませんでしたが,時間があればまた色々と試してみたいと思います.

- [Stability-AI'23]: "Stable Diffusion 2.0," available here, 2023.

- [Rombach'23]: R. Rombach et al., "High-Resolution Image Synthesis with Latent Diffusion Models," Proc. of the IEEE CVPR, available here, 2022.

- [SBERT'23]: "Sentence-Transformers," available here, 2023.

- [Reimers'19]: N. Reimers and I. Gurevych, "Sentence-BERT: Sentence Embeddings using Siamese BERT-Networks," Proc. of the EMNLP, available here, 2019.