Pydanticを用いてTransformerベースの孤立手話単語認識モデルをリファクタリングしましたので,実装コードを紹介します.

Pydanticを用いてTransformerベースの孤立手話単語認識モデルをリファクタリングしましたので,実装コードを紹介します.

Transformer Encoder-Decoder を用いた連続指文字認識モデルを紹介します.題材は連続指文字認識ですが,手法は連続手話単語認識や手話翻訳にも応用可能です.

Transformer の補足説明として,Multi-head cross attention の処理について紹介します.

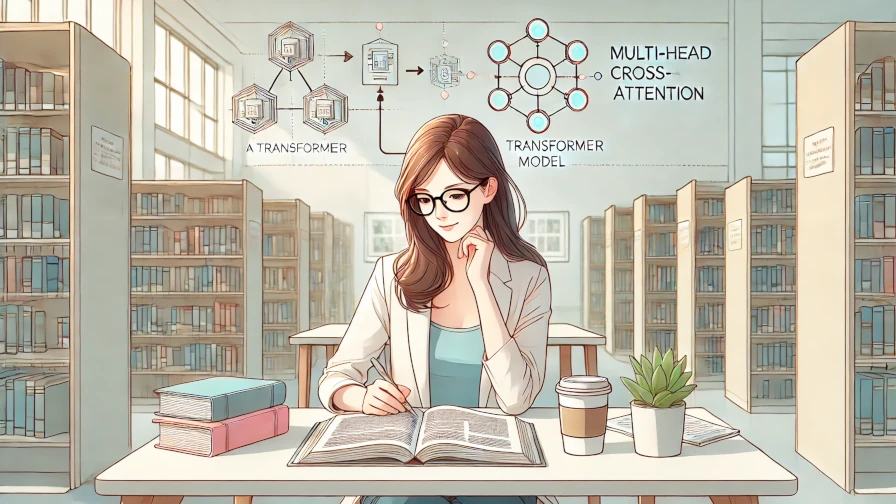

Transformerの正規化層を変えた場合,認識性能が向上するのかを実験しました.

追跡点の欠損値を補間した場合,認識性能が向上するのかを実験しました.