目次

こんにちは.高山です.

先日の記事で告知しました手話入門記事の第七回になります.

第五回と第六回に引き続いて,今回もRecurrent Neural Network (RNN) を用いた孤立手話単語認識モデルを実装する方法を紹介します.

第五回の記事の冒頭で,RNNの設計上のポイントとして次の3点を挙げました.

- レイヤ構成: Stacked RNNとBidirectional RNN

- Padding信号のマスキング

- レイヤ種別: LSTMとGRU

前回までにレイヤ構成とPadding信号のマスキングについて説明したので,今回はレイヤ種別の選択に焦点を絞って紹介をしたいと思います.

今回解説するスクリプトはGitHub上に公開しています.

色々な実験を行っていることと,今回は30単語のデータセットも用いて実験をしているので,CPUで動かした場合はかなり時間がかるのでご注意ください.

更新履歴 (大きな変更のみ記載しています)

- 2024/09/18: カテゴリを変更しました

- 2024/09/17: タグを更新しました

- 2024/07/29: Gitスクリプトのダウンロード元を

masterからv0.1タグに変更 - 2024/07/23

- 第1節の構成を見直し

- 記事最終部の実験結果を削除して第3節に統合

- 2024/03/1

- 1.1項でPyTorchのLSTMが文献[4]に基づいていると説明しましたが,正確で無かったので訂正しました.

- 処理ブロックの説明を記入して,図3を更新 (現在では図2になっています)

1. モデルの改良内容

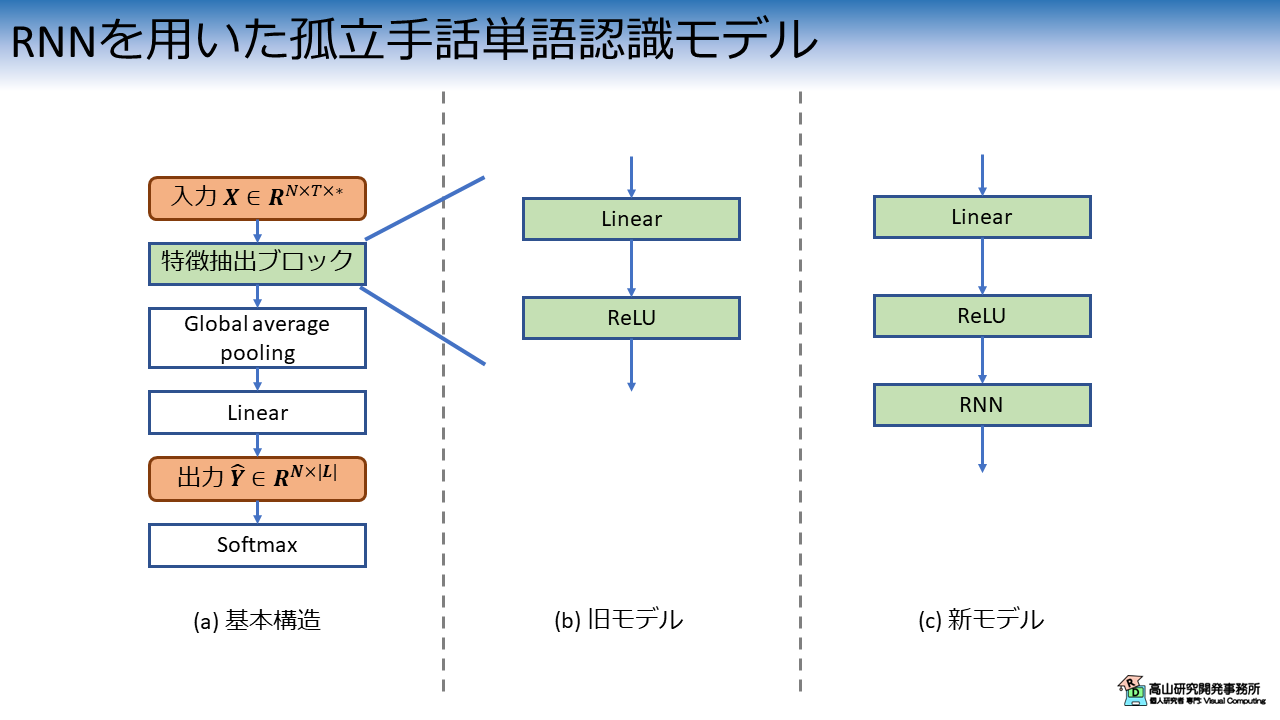

第5回の記事では,図1(c)に示すように特徴抽出ブロックにRNN層を加えてモデルの改善を行いました.

このときは simple RNN (SRNN) 層を用いましたが,今回はSRNNを改良した long short term memory (LSTM)[Hochreiter'97, Gers'00, Gers'03, Sak'14] と gated recurrent unit (GRU)[Cho'14] を用います.

LSTMはオリジナル[Hochreiter'97]から段階的に改善[Gers'00, Gers'03, Sak'14]されていっているので少しややこしいですが,PyTorchの実装は文献[Gers'00]をベースに,文献[Sak'14]の機構の一部を (オプション的に) 取り入れた形になっています.

- [Hochreiter'97]: S. Hochreiter, "Long Short-term Memory," Neural Computation, Vol.9, No.8, pp.1735-80, available here, 1997.

- [Gers'00]: F. A. Gers, et al., "Learning to forget: continual prediction with LSTM," Neural Computation, Vol.12, No.10, pp.2451-2471, available here, 2000.

- [Gers'03]: F. A. Gers, et al., "Learning precise timing with LSTM recurrent network," Journal of Machine Learning Research, Vol.3, pp.115-143, available here, 2003.

- [Sak'14]: H. Sak, et al., "Long Short-Term Memory Based Recurrent Neural Network Architectures for Large Vocabulary Speech Recognition," arXiv:1402.1128, available here, 2014.

- [Cho'14]: K. Cho, et al., "Learning Phrase Representations using RNN Encoder–Decoder for Statistical Machine Translation," Proc. of the EMNLP, available here, 2014.

2. レイヤ種別の選択

PyTorchではRNNタイプのレイヤとして,SRNNに加えて図3に示すLSTMとGRUを選択できるようになっています.

LSTMとGRUは共に,SRNNの弱点である勾配消失問題 (vanishing gradient problem) と長期の依存関係問題 (long-term dependency problem) の解決を図って提案されたアーキテクチャです.

SRNNに比べてLSTMとGRUは複雑な内部機構になっていますが,現在の入力特徴量 (\(\boldsymbol{x}_t\)) と過去の出力特徴量 (\(\boldsymbol{h}_{t-1}, \boldsymbol{c}_{t-1}\)) から,現在の出力特徴量 (\(\boldsymbol{h}_{t}, \boldsymbol{c}_{t}\)) を計算するという点は変わりません.

LSTMとGRUの内部構造についてはまた別記事で取り上げるとして,今回は認識モデルの実装に注目して紹介したいと思います.

3. 実験結果

次節以降では,いつも通り実装の紹介をしながら実験結果をお見せします.

今回はレイヤ種別選択の効果を見るために複数の実験条件を実装しており,少し冗長な展開が続きますので結果を先にお見せしたいと思います.

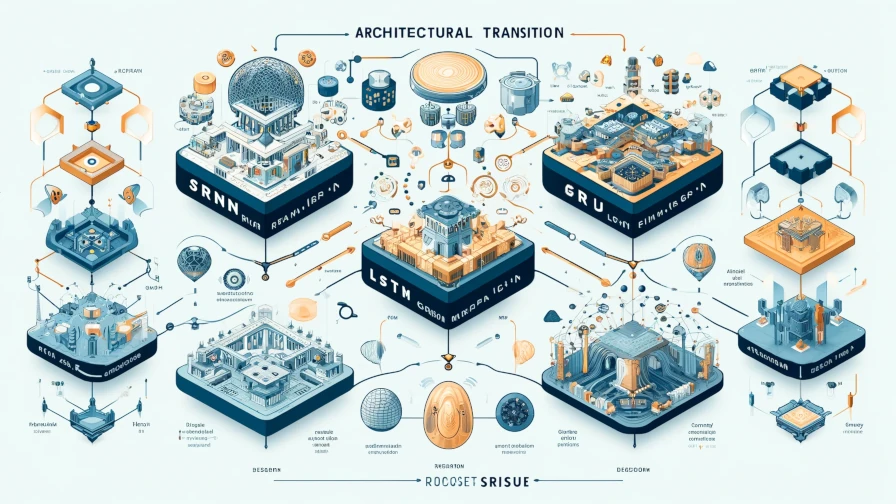

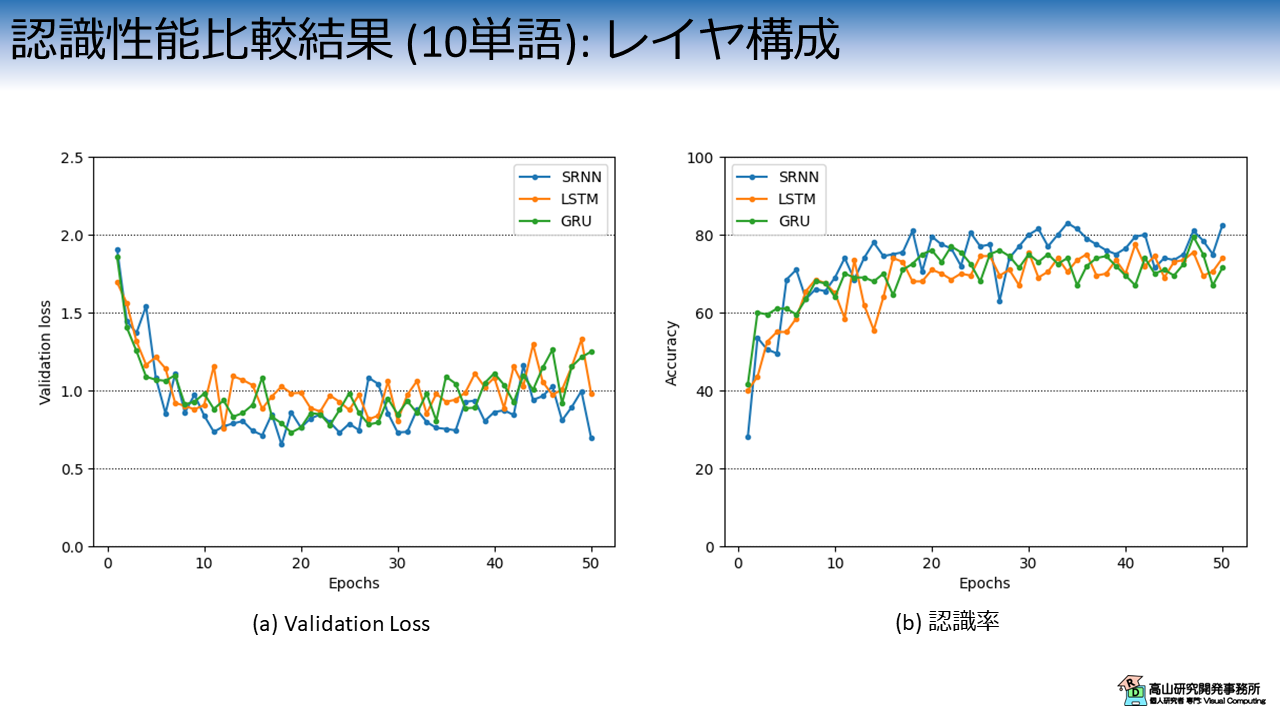

3.1 頻度の多い10単語の実験結果

図3はレイヤ種別毎のValidation Lossと認識率の推移を示しています.

横軸は学習・評価ループの繰り返し数 (Epoch) を示します.

縦軸はそれぞれの評価指標を示します.

各線の色と実験条件の関係は次のとおりです.

- 青線 (SRNN): Stacked - Bidirectional RNN

- 橙線 (LSTM): Stacked - Bidirectional LSTM

- 緑線 (GRU): Stacked - Bidirectional GRU

予想に反して,SRNNの方が良い結果となりました.

要因としては,下記のような理由が考えられます.

- データ数が少ないため,LSTMやGRUでは汎化性能が得られなかった (過学習気味).

- LSTMやGRUの利点である,長期の依存関係を捉える機構が活かせなかった.

- 手話の特徴量は隣接フレーム間の相関が高い.

- 孤立手話単語なので離れたフレーム間の依存関係があまりない.

- 最後にGlobal Average Poolingで全フレーム特徴量を平均化する機構や,Bidirectional RNNがSRNNの問題点を緩和している.

2番目と3番目に挙げた要因は,仮説としては有り得ると思っていますが,実験で確かめるのが難しいです.

ここでは1番目の要因を確かめるために,少し大きなデータで再実験を行ってみます.

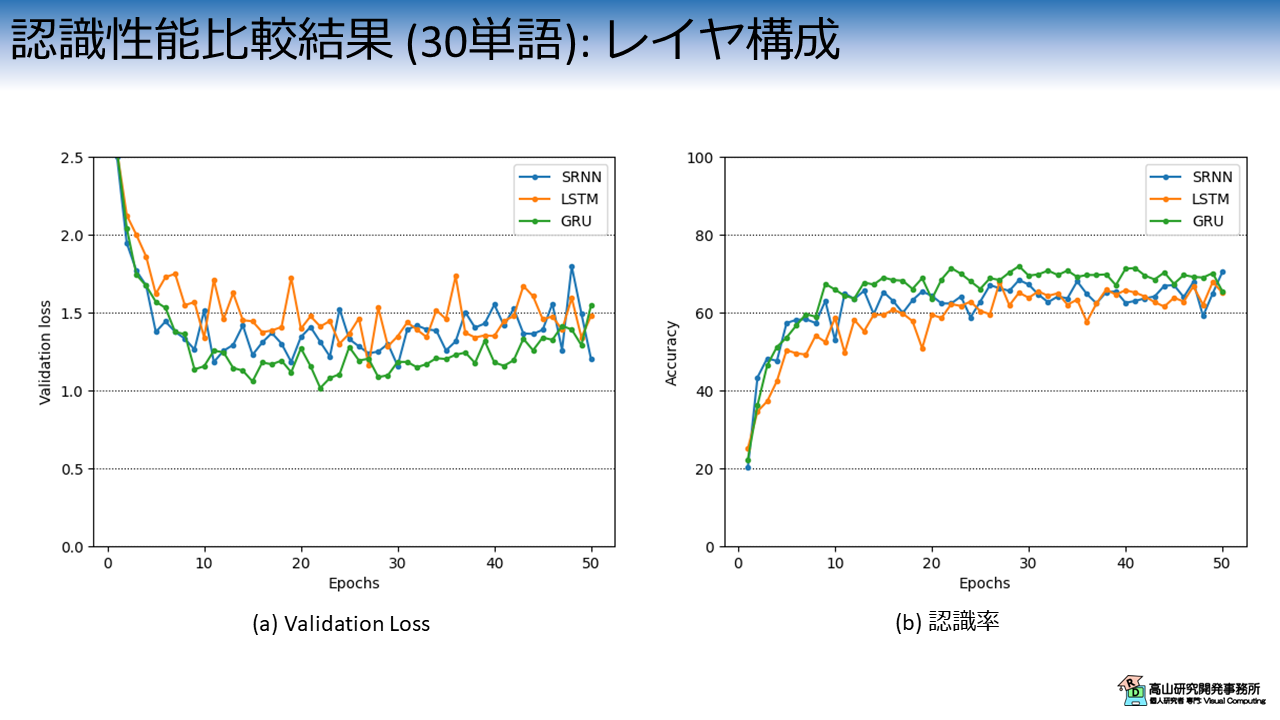

3.2 頻度の多い30単語の実験結果

図4は同様の実験を30単語分のデータを使用して行った際の,レイヤ種別毎のValidation Lossと認識率の推移を示しています.

GRUは予想どおりの結果になり,LSTMはここでもあまり良い結果ではありませんでした.

何回か試したところLSTMがSRNNを上回るケースもそれなりにあったので,チューニングの問題と考えられます.

GRUは比較的性能が安定していて,LSTMは変動が多い印象です.

GRUの内部機構は,LSTMの内部機構をシンプルにしたような作りになっていますので,それが良い結果に結びついていると思われます.

なお,今回の実験では話を簡単にするために,実験条件以外のパラメータは固定にし,乱数の制御もしていません.

複数回試して認識性能の傾向は確認していますが,必ずしも同様の結果になるわけではないので,ご了承ください.

4. 前準備

4.1 データセットのダウンロード

ここからは実装方法の説明をしていきます.

まずは,前準備としてGoogle Colabにデータセットをアップロードします.<

今回は10単語と30単語のデータセットを使用します.

最初に,データセットの格納先から10単語と30単語のデータセットをダウンロードし,ご自分のGoogle driveへアップロードしてください.

次のコードでGoogle driveをColabへマウントします.

Google Driveのマウント方法については,補足記事にも記載してあります.

1 2 3 | |

ドライブ内のファイルをColabへコピーします.

パスはアップロード先を設定する必要があります.

# Copy to local.

!cp drive/MyDrive/Datasets/gislr_dataset_top10.zip gislr_top10.zip

!cp drive/MyDrive/Datasets/gislr_dataset_top30.zip gislr_top30.zip

データセットはZIP形式になっているので unzip コマンドで解凍します.

!unzip -o gislr_top10.zip

!unzip -o gislr_top30.zip

Archive: gislr_top10.zip

creating: dataset_top10/

inflating: dataset_top10/16069.hdf5

...

inflating: dataset_top10/sign_to_prediction_index_map.json

Archive: gislr_top30.zip

creating: dataset_top30/

inflating: dataset_top30/16069.hdf5

...

inflating: dataset_top30/sign_to_prediction_index_map.json

成功すると dataset_top10 と dataset_top30 配下にデータが解凍されます.

HDF5ファイルはデータ本体で,手話者毎にファイルが別れています.

JSONファイルは辞書ファイルで,TXTファイルは本データセットのライセンスです.

!ls dataset_top10

!ls dataset_top30

16069.hdf5 25571.hdf5 29302.hdf5 36257.hdf5 49445.hdf5 62590.hdf5

18796.hdf5 26734.hdf5 30680.hdf5 37055.hdf5 53618.hdf5 LICENSE.txt

2044.hdf5 27610.hdf5 32319.hdf5 37779.hdf5 55372.hdf5 sign_to_prediction_index_map.json

22343.hdf5 28656.hdf5 34503.hdf5 4718.hdf5 61333.hdf5

16069.hdf5 25571.hdf5 29302.hdf5 36257.hdf5 49445.hdf5 62590.hdf5

18796.hdf5 26734.hdf5 30680.hdf5 37055.hdf5 53618.hdf5 LICENSE.txt

2044.hdf5 27610.hdf5 32319.hdf5 37779.hdf5 55372.hdf5 sign_to_prediction_index_map.json

22343.hdf5 28656.hdf5 34503.hdf5 4718.hdf5 61333.hdf5

単語辞書には単語名と数値の関係が使用単語分定義されています.

!cat dataset_top10/sign_to_prediction_index_map.json

!cat dataset_top30/sign_to_prediction_index_map.json

{

"listen": 0,

"look": 1,

"shhh": 2,

"donkey": 3,

"mouse": 4,

"duck": 5,

"uncle": 6,

"hear": 7,

"pretend": 8,

"cow": 9

}{

"listen": 0,

"look": 1,

"shhh": 2,

"donkey": 3,

"mouse": 4,

"duck": 5,

"uncle": 6,

"hear": 7,

"pretend": 8,

"cow": 9,

"bird": 10,

"brown": 11,

"who": 12,

"sleepy": 13,

"toothbrush": 14,

"nuts": 15,

"lips": 16,

"bye": 17,

"fireman": 18,

"wake": 19,

"awake": 20,

"doll": 21,

"cat": 22,

"drink": 23,

"pen": 24,

"think": 25,

"icecream": 26,

"make": 27,

"yesterday": 28,

"first": 29

}

ライセンスはオリジナルと同様に,CC-BY 4.0 としています.

!cat dataset_top10/LICENSE.txt

The dataset provided by Natsuki Takayama (Takayama Research and Development Office) is licensed under CC-BY 4.0.

Author: Copyright 2024 Natsuki Takayama

Title: GISLR Top 10 dataset

Original licenser: Deaf Professional Arts Network and the Georgia Institute of Technology

Modification

- Extract 10 most frequent words.

- Packaged into HDF5 format.

!cat dataset_top30/LICENSE.txt

The dataset provided by Natsuki Takayama (Takayama Research and Development Office) is licensed under CC-BY 4.0.

Author: Copyright 2024 Natsuki Takayama

Title: GISLR Top 30 dataset

Original licenser: Deaf Professional Arts Network and the Georgia Institute of Technology

Modification

- Extract 30 most frequent words.

- Packaged into HDF5 format.

次のコードでサンプルを確認します.

サンプルは辞書型のようにキーバリュー形式で保存されており,下記のように階層化されています.

- サンプルID (トップ階層のKey)

|- feature: 入力特徴量で `[C(=3), T, J(=543)]` 形状.C,T,Jは,それぞれ特徴次元,フレーム数,追跡点数です.

|- token: 単語ラベル値で `[1]` 形状.0から9の数値です.

1 2 3 4 5 6 7 8 9 | |

['1109479272', '11121526', ..., '976754415']

<KeysViewHDF5 ['feature', 'token']>

(3, 23, 543)

[1]

4.2 モジュールのダウンロード

次に,過去の記事で実装したコードをダウンロードします.

本項は前回までに紹介した内容と同じですので,飛ばしていただいても構いません.

コードはGithubのsrc/modules_gislrにアップしてあります (今後の記事で使用するコードも含まれています).

まず,下記のコマンドでレポジトリをダウンロードします.

(目的のディレクトリだけダウンロードする方法はまだ調査中です(^^;))

!wget https://github.com/takayama-rado/trado_samples/archive/refs/tags/v0.1.zip -O master.zip

--2024-01-21 11:01:47-- https://github.com/takayama-rado/trado_samples/archive/master.zip

Resolving github.com (github.com)... 140.82.112.3

...

2024-01-21 11:01:51 (19.4 MB/s) - ‘master.zip’ saved [75710869]

ダウンロードしたリポジトリを解凍します.

!unzip -o master.zip -d master

Archive: master.zip

641b06a0ca7f5430a945a53b4825e22b5f3b8eb6

creating: master/trado_samples-main/

inflating: master/trado_samples-main/.gitignore

...

モジュールのディレクトリをカレントディレクトリに移動します.

!mv master/trado_samples-main/src/modules_gislr .

他のファイルは不要なので削除します.

!rm -rf master master.zip gislr_top10.zip gislr_top30.zip

!ls

dataset_top10 dataset_top30 drive modules_gislr sample_data

4.3 モジュールのロード

主要な処理の実装に先立って,下記のコードでモジュールをロードします.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 | |

【コード解説】

- 標準モジュール

- json: JSONファイル制御ライブラリ.辞書ファイルのロードに使用します.

- math: 数学計算処理ライブラリ

- sys: Pythonインタプリタの制御ライブラリ.

今回はローカルモジュールに対してパスを通すために使用します.

- time: 時間計測ライブラリ

- functools: 関数オブジェクトを操作するためのライブラリ.

今回はDataLoaderクラスに渡すパディング関数に対して設定値をセットするために使用します.

- pathlib.Path: オブジェクト指向のファイルシステム機能.

主にファイルアクセスに使います.osモジュールを使っても同様の処理は可能です.

高山の好みでこちらのモジュールを使っています(^^;).

- typing: 関数などに型アノテーションを行う機能.

ここでは型を忘れやすい関数に付けていますが,本来は全てアノテーションをした方が良いでしょう(^^;).

- 3rdパーティモジュール

- numpy: 行列演算ライブラリ

- torch: ニューラルネットワークライブラリ

- torchvision: PyTorchと親和性が高い画像処理ライブラリ.

今回はDatasetクラスに与える前処理をパッケージするために用います.

- ローカルモジュール: sys.pathにパスを追加することでロード可能

- dataset: データセット操作用モジュール

- defines: 各部位の追跡点,追跡点間の接続関係,およびそれらへのアクセス処理を

定義したモジュール

- layers: ニューラルネットワークのモデルやレイヤモジュール

- transforms: 入出力変換処理モジュール

- train_functions: 学習・評価処理モジュール

5. 認識モデルの実装

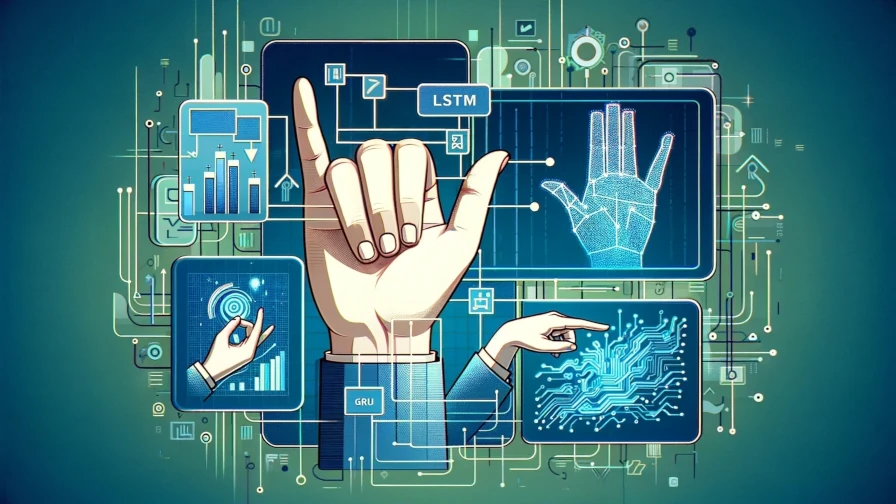

5.1 RNN Encoder層

ここから先は,認識モデルを実装していきます.

まずは,前回の記事で実装した (第6.1項をご参照ください) RNN層をベースとして,引数に応じてLSTMとGRUを選択できるように拡張します.

レイヤ種別を指定する rnn_type を追加し,値に応じてインスタンス化するRNN層を切り替えています.

また,LSTM固有の引数である proj_size (今回は使用していません) も追加しています.

LSTMだけ他のRNN層とインターフェースが異なるため (セルステートを返すため),forward 内で分岐を入れています.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 | |

【コード解説】

- 引数

- in_channels: 入力特徴量の次元数

- out_channels: 出力特徴量の次元数

bidir=Trueの場合,出力特徴量次元数は設定値の倍になります.

- rnn_type: RNN層の種別を指定 [srnn/lstm/gru]

- num_layers: RNN層の数

- activation: RNN層内の活性化関数.

["tanh"/"relu"]で指定します.

- bidir: Trueの場合,Bidirectional RNNを使用

- dropout: Dropoutレイヤの欠落率

- apply_mask: Trueの場合,マスキング処理を行う.

- proj_size: 0以上の場合,H. Sakらの拡張型LSTM層を使用します.

https://arxiv.org/abs/1402.1128

- 12-49行目: 初期化処理

- 16行目: RNN内のDropoutは `num_layers > 1` の場合のみ有効という仕様であるため,

警告を避けるために `num_layers=1` の場合は設定値を上書きしています.

- 18-40行目: RNN層の作成

- 43-46行目: RNN内のDropoutは最後のRNN層には適用されないという仕様であるため,

明示的にDropout層を作成しています.

- 49行目: `apply_mask` をセット

- 51-79行目: 推論処理

- 52-55行目: `apply_mask == True` で,かつ,`feature_pad_mask is not None` の

場合は,`feature` をPackedSequence型に変換

- 57-61行目: RNN層を適用.LSTMだけ返り値が異なるので,インスタンスの型を基に

分岐しています.

- 63-67行目: `feature` がPackedSequence型の場合は,Tensor型に戻し,さらに,

再度Paddingを行う.

- 68行目: Dropoutを適用

5.2 認識モデル

次に,認識モデルを更新します.

RNN層を選択できるようにインタフェースを更新しています.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 | |

【コード解説】

- 引数

- in_channels: 入力特徴量の次元数

- hidden_channels: RNN層の次元数.

rnn_bidir=Trueの場合,内部では設定値の倍次元の特徴量を出力します.

- out_channels: 出力特徴量の次元数.単語応答値を出力したいので,全単語数と同じにします.

- rnn_type: RNN層の種別を指定 [srnn/lstm/gru]

- rnn_num_layers: RNN層の数

- rnn_activation: RNN層内の活性化関数.

["tanh"/"relu"]で指定します.

- rnn_bidir: Trueの場合,Bidirectional RNNを使用

- rnn_dropout: Dropoutレイヤの欠落率

- masking_type: 指定に応じて,マスキングを適用します.

- none: マスキングは行わない

- rnn: RNN層だけマスキングを行う

- head: 出力層だけマスキングを行う

- both: RNN層と出力層でマスキングを行う

- 12-35行目: 初期化処理

- 19-28行目: RNN層でマスキングを行う場合は,`apply_mask = True` として,`RNNEncoder` に渡します.

- 30-33行目: `rnn_bidir` の設定に応じて,出力層の入力次元を調整しています.

- 37-56行目: 推論処理

- 52-53行目: 出力層でマスキングを行う場合は,`feature_pad_mask` を渡します.

5.3 動作チェック

認識モデルの実装ができましたので,動作確認をしていきます.

次のコードでデータセットからHDF5ファイルとJSONファイルのパスを読み込みます.

1 2 3 4 5 6 7 8 | |

dataset_top10/sign_to_prediction_index_map.json

[PosixPath('dataset_top10/25571.hdf5'), ..., PosixPath('dataset_top10/62590.hdf5')]

次のコードで辞書ファイルをロードして,認識対象の単語数を格納します.

1 2 3 4 5 | |

次のコードで前処理を定義します.

前回と同様に,以前に説明した追跡点の選定と,追跡点の正規化を前処理として適用して実験を行います.

1 2 3 4 5 6 7 8 9 10 | |

次のコードで,前処理を適用したHDF5DatasetとDataLoaderをインスタンス化し,データを取り出します.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 | |

torch.Size([2, 2, 10, 130])

次のコードでモデルをインスタンス化して,動作チェックをします.

追跡点抽出の結果,入力追跡点数は130で,各追跡点はXY座標値を持っていますので,入力次元数は260になります.

出力次元数は単語数なので10になります.

また,RNN層の次元数は64に設定しています.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 | |

RNNISLR(

(linear): Linear(in_features=260, out_features=64, bias=True)

(activation): ReLU()

(rnn): RNNEncoder(

(rnn): RNN(64, 64, num_layers=2, batch_first=True, dropout=0.1, bidirectional=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(head): GPoolRecognitionHead(

(head): Linear(in_features=128, out_features=10, bias=True)

)

)

torch.Size([2, 10])

6. 学習と評価

6.1 共通設定

では,実際に学習・評価を行います.

まずは,実験全体で共通して用いる設定値を次のコードで実装します.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 | |

Using cuda for computation.

次のコードで学習・バリデーション・評価処理それぞれのためのDataLoaderクラスを作成します.

1 2 3 4 5 6 7 8 9 10 11 | |

6.2 学習・評価の実行

次のコードでモデルをインスタンス化します.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 | |

RNNISLR(

(linear): Linear(in_features=260, out_features=64, bias=True)

(activation): ReLU()

(rnn): RNNEncoder(

(rnn): RNN(64, 64, num_layers=2, batch_first=True, dropout=0.1, bidirectional=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(head): GPoolRecognitionHead(

(head): Linear(in_features=128, out_features=10, bias=True)

)

)

次のコードで学習・評価処理を行います.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 | |

Start training.

--------------------------------------------------------------------------------

Epoch 1

Start training.

loss:2.373737 [ 0/ 3881]

loss:1.532740 [ 3200/ 3881]

Done. Time:8.564445982000052

Training performance:

Avg loss:1.812135

Start validation.

Done. Time:0.25789257200000293

Validation performance:

Avg loss:1.908761

Start evaluation.

Done. Time:0.9120091590000357

Test performance:

Accuracy:28.0%

--------------------------------------------------------------------------------

...

--------------------------------------------------------------------------------

Epoch 50

Start training.

loss:0.169248 [ 0/ 3881]

loss:0.412059 [ 3200/ 3881]

Done. Time:5.579133695999985

Training performance:

Avg loss:0.210403

Start validation.

Done. Time:0.4002665179999667

Validation performance:

Avg loss:0.695182

Start evaluation.

Done. Time:1.0316639970000097

Test performance:

Accuracy:82.5%

Minimum validation loss:0.6508724987506866 at 18 epoch.

Maximum accuracy:83.0 at 34 epoch.

以後,同様の処理をRNNのレイヤ種別毎に繰り返します.

コード構成は同じですので,ここでは説明を割愛させていただきます.

今回はRNN層を用いた孤立手話単語認識モデルに対して,レイヤの種別を選択できるようにして認識性能を検証してみましたが,如何でしたでしょうか?

LSTM層の性能が思ったよりも伸びない原因を探るのに苦労して,時間がかかってしまいました(^^;).

RNN層は時系列認識によく用いられる技術ですが,チューニングに結構苦労することが多いです.

対策は色々と提案されていますので,機会があればまた別記事で取り上げていきたいと思います.

今回紹介した話が,これから手話認識を勉強してみようとお考えの方に何か参考になれば幸いです.